1月2日大模型日報合輯

【1月2日大模型日報合輯】大模型幻覺問題無解? 理論證明校準的LM必然會出現幻覺;華為改進Transformer架構! 盤古-π解決特徵缺陷問題,同規模性能超LLaMA;清華大學攜手哈佛大學,共同開發了名為 LangSplat 的全新 AI 系統,能夠在三維空間內高效、準確地搜尋開放式詞彙

文生影片下一站,Meta已經開始視訊生影片了

連結:https://news.miracleplus.com/share_link/14822

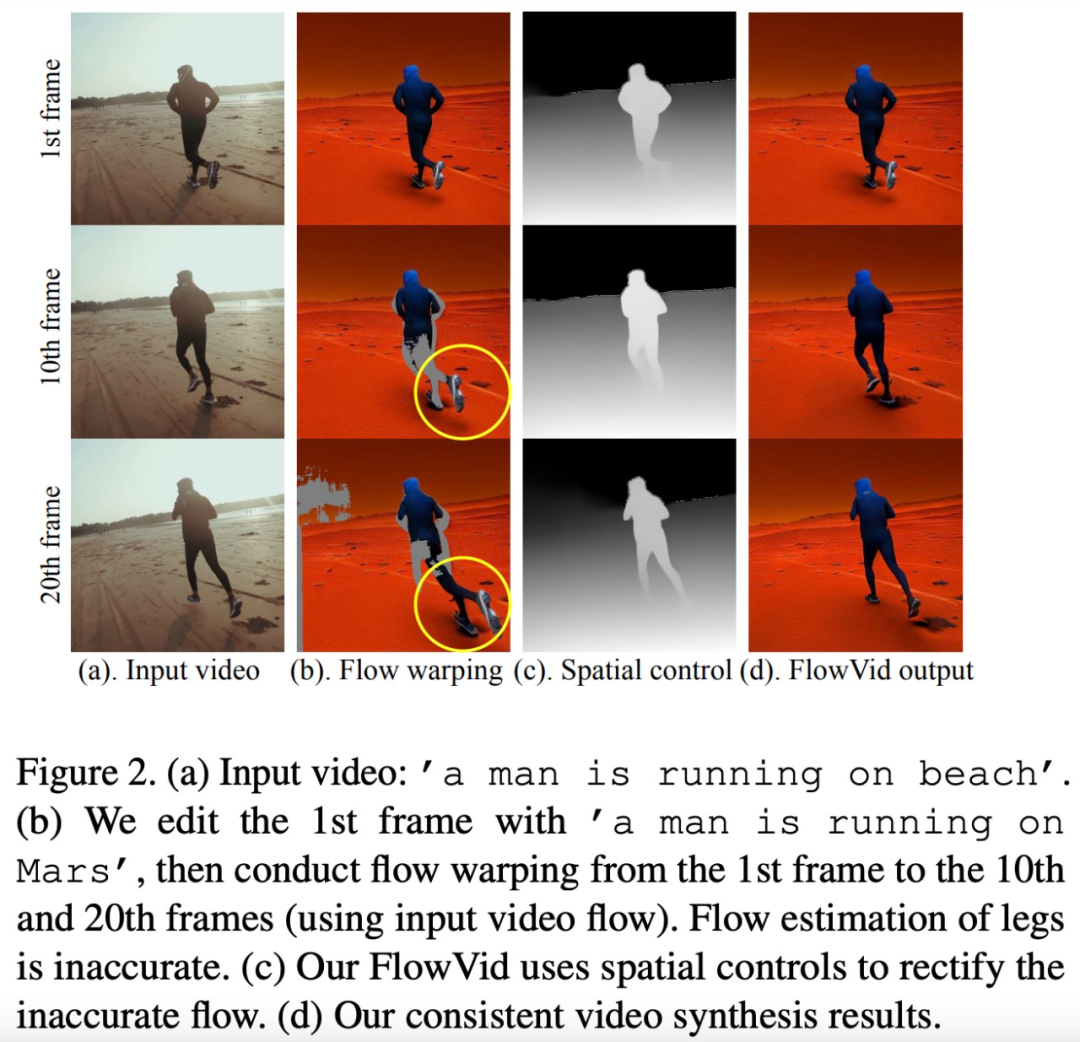

文字指導的影片到影片(V2V)合成在各個領域具有廣泛的應用,例如短視頻創作以及更廣泛的電影行業。 擴散模型已經改變了影像到影像(I2I)的合成方式,但在視訊到視訊(V2V)合成方面面臨維持視訊幀間時間一致性的挑戰。 在影片上套用 I2I 模型通常會在影格之間產生像素閃爍。 為了解決這個問題,來自得州大學奧斯汀分校、Meta GenAI 的研究者提出了一種新的 V2V 合成框架 ——FlowVid,聯合利用了源視頻中的空間條件和時間光流線索(clue)。 給定輸入影片和文字 prompt,FlowVid 就可以合成時間一致的影片。

給3D資產生成高清紋理,騰訊讓AI擴充遊戲皮膚

連結:https://news.miracleplus.com/share_link/14823

近日,騰訊宣布推出一項名為 Paint3D 的技術,它能夠根據文字或圖像輸入,為無紋理的 3D 模型生成高解析度、無光照且多樣化的紋理貼圖,對任何 3D 物件進行紋理繪製。

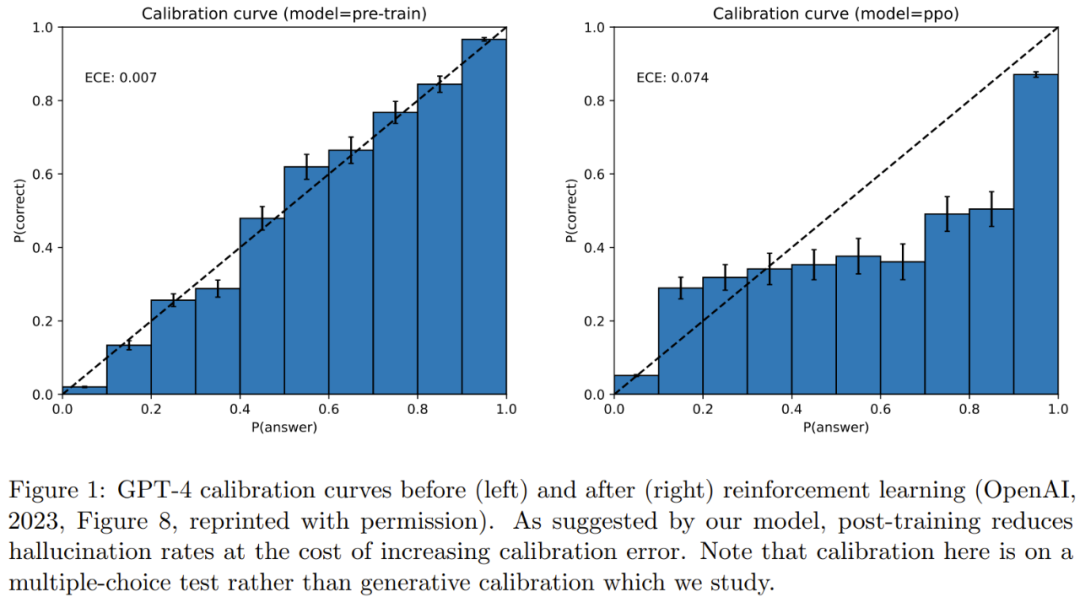

大模型幻覺問題無解? 理論證明校準的LM必然會出現幻覺

連結:https://news.miracleplus.com/share_link/14824

大型語言模型(LLM)雖然在許多下游任務上展現出卓越的能力,但其實際應用仍存在一些問題。 其中,LLM 的「幻覺(hallucination)」問題就是一個重要缺陷。 幻覺是指由人工智慧演算法產生看似合理但卻是虛假或有誤導性的反應。 自 LLM 爆火以來,研究人員一直在努力分析和緩解幻覺問題,這使得 LLM 很難廣泛應用。 現在,一項新研究得出結論:「經過校準的語言模型必然會出現幻覺。」研究論文是微軟研究院高級研究員Adam Tauman Kalai 和佐治亞理工學院教授Santosh S. Vempala 近日發表的《Calibrated Language Models Must Hallucinate》。 該論文顯示預訓練語言模型對特定類型的事實產生幻覺存在一個固有的統計原因,而與 Transformer 架構或資料品質無關。

華為改進Transformer架構! 盤古-π解決特徵缺陷問題,同規模性能超LLaMA

連結:https://news.miracleplus.com/share_link/14825

華為盤古系列,帶來架構層面新。 華為諾亞方舟實驗室等聯合推出新型大語言模型架構:盤古-π。 它透過增強非線性,在傳統Transformer架構上做出改進,由此可以顯著降低特徵塌陷問題。 帶來的直接效果就是模型輸出表達能力更強。 在使用相同資料訓練的情況下,盤古-π(7B)在多任務上超越LLaMA 2等同規模大模型,並能實現10%的推理加速。 在1B規模上可達SOTA。 同時也基於這項架構煉出了一個金融法律大模型「雲山」。 此工作由AI大牛陶大程領軍。

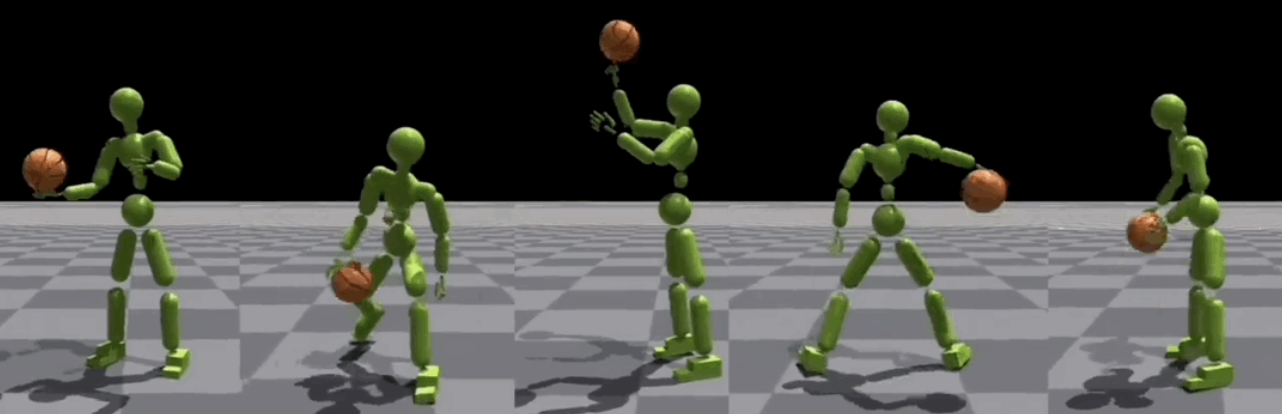

「灌籃高手」模擬人形機器人,一比一照搬人類籃球招式,看一遍就能學會,無需特定任務的獎勵

連結:https://news.miracleplus.com/share_link/14826

最近一項名為PhysHOI的新研究,能夠讓物理模擬的人形機器人透過觀看人與物體互動(HOI)的演示,學習並模仿這些動作和技巧。 重點是,PhysHOI無需為每個特定任務設定具體的獎勵機制,機器人可以自主學習和適應。 而且機器人的身上總共有51×3個獨立控制點,所以模仿起來可以做到高度逼真。

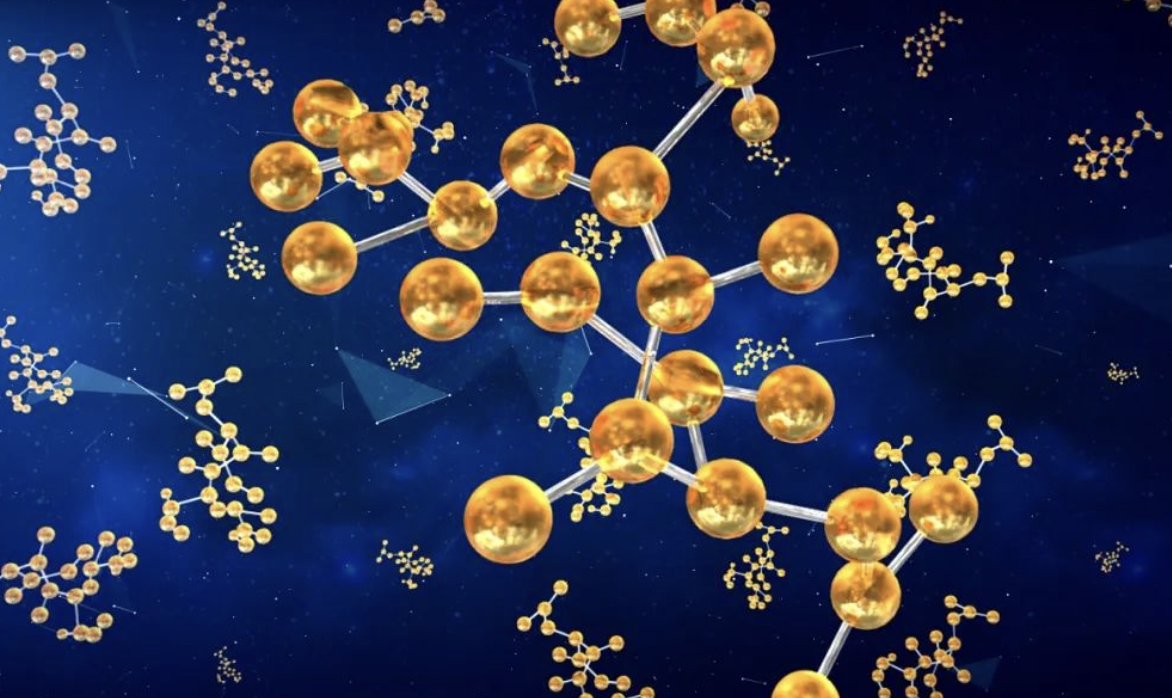

發現、合成並表徵303個新分子,MIT團隊開發機器學習驅動的閉環自主分子發現平台

連結:https://news.miracleplus.com/share_link/14827

傳統意義上,發現所需特性的分子過程一直是由手動實驗、化學家的直覺以及對機制和第一原理的理解所推動的。 隨著化學家越來越多地使用自動化設備和預測合成演算法,自主研究設備越來越接近實現。 近日,來自 MIT 的研究人員開發了由整合機器學習工具驅動的閉環自主分子發現平台,以加速具有所需特性的分子的設計。 無需手動實驗即可探索化學空間並利用已知的化學結構。 在兩個案例研究中,該平台嘗試了 3000 多個反應,其中 1000 多個產生了預測的反應產物,提出、合成並表徵了 303 種未報道的染料樣分子。

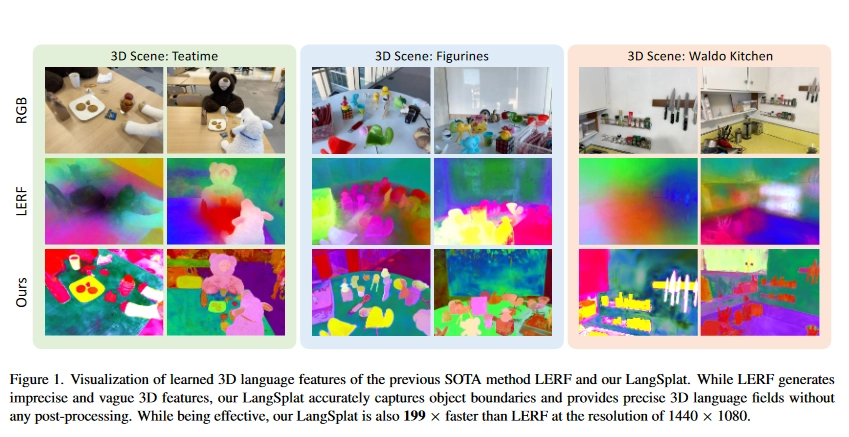

清華大學攜手哈佛大學,共同開發了名為 LangSplat 的全新 AI 系統,能夠在三維空間內高效、準確地搜尋開放式詞彙。

連結:https://news.miracleplus.com/share_link/14828

LangSplat 是第一個基於 3DGS 的 3D 語言場方法,特別引入了 SAM 和 CLIP,在開放詞彙 3D 物件定位和語義分割任務上優於最先進的方法,同時比 LERF 快 199 倍。 加州大學柏克萊分校的研究人員於2023 年3 月展示了語言嵌入式輻射場(LERF),將語言嵌入從現成模型(如CLIP)嵌入到NeRF 中,從而在不需要專門培訓的情況下,在三維 環境中準確辨識物體。 例如在書店的 NeRF 環境中,使用者可以用自然語言搜尋特定的書名。 這項技術還可用於機器人技術、模擬機器人的視覺訓練以及人類與三維世界的互動。