10月28日から10月29日までの毎日の大型モデル集

【10月28日から10月29日までの毎日の大型モデル集】Google、Anthropicに20億ドル投資:大型モデルの軍拡競争が激化、最高の7Bモデルが再び交代! 700 億の LLaMA2 を倒すと、Apple コンピュータは実行可能|オープンソースで無料、Transformer、BERT、GPT よりも優れており、MLP は実際に強力です

Google、Anthropic に 20 億ドルを支出: 大型モデルの軍拡競争が激化

リンク: https://news.miracleplus.com/share_link/11252

同社はOpenAIの主要な競合他社に5億ドルを先行投資し、その後さらに15億ドルを投資することに同意したと広報担当者は述べた。 GoogleはすでにAnthropicへの重要な投資家であり、大手ハイテク企業が自社のビジネスへの人工知能の統合を競う中、今回の投資は同社がMicrosoftと競争する取り組みを強化するのに役立つだろう。 Anthropic は、OpenAI の元研究担当副社長である Dario Amodei 氏、GPT-3 論文の筆頭著者である Tom Brown 氏らによって 2021 年に共同設立された生成 AI スタートアップで、カリフォルニア州サンフランシスコに本社を置いています。 同社の創設メンバーのほとんどは OpenAI の中核従業員であり、OpenAI の GPT-3 や Reinforcement Learning with Human Preferences (RLHF) などの多くの研究プロジェクトに深く関わってきました。

最高の7Bモデルが再び手を替えます! 700 億個の LLaMA2 を倒すと Apple コンピュータで実行可能 | オープンソースで無料

リンク: https://news.miracleplus.com/share_link/11253

「調整」に 500 ドルかかる 70 億パラメータのモデルは、700 億パラメータの Llama 2 を上回ります。 ラップトップでも簡単に実行でき、その効果は ChatGPT に匹敵します。 重要なポイント: 無料、お金は必要ありません。 HuggingFace H4 チームが作成したオープンソース モデル Zephyr-7B がデビューします。 基礎となるモデルは、Mistral AI によって作成された大規模なオープン ソース モデルである Mistral-7B です。これは、少し前に人気になり、「ヨーロッパ OpenAI」として知られています。 ご存知のとおり、Mistral-7Bのリリースから2週間も経たないうちに、Llamaが最初にリリースされたとき、さまざまな「アルパカ」のトレンドがすぐに現れたのと同じように、さまざまなファインチューンバージョンが次々に登場しました。 Zephyr が亜種の中で際立っている能力の鍵は、チームが Direct Preference Optimization (DPO) を使用して、Mistral に基づく公開データ セットでモデルを微調整したことです。 チームはまた、データセットの組み込みアライメントを削除すると、MT Bench のパフォーマンスがさらに向上する可能性があることも発見しました。 第一世代 Zephyr-7B-alpha の平均 MT-Bench スコアは 7.09 で、Llama2-70B-Chat を上回っています。

Yuanchengxiang Chatimg 3.0 は GPT-4V に追いつき、業界をアップグレードする新しい方法も提供します

リンク: https://news.miracleplus.com/share_link/11254

10月28日に開催されたCNCC 2023「超知能融合AI大規模モデルアプリケーション実装開発フォーラム」において、Sophon Engineは「Yuancheng Xiang Chatimg3.0」をリリースし、マルチモーダル汎用生成モデル「Yuancheng Xiang Chatimg3.0.0」のデモンストレーションを行いました。の最新の進捗状況と実装の調査。 Yuanchengxiang Chatimg3.0 は、超微細な認識と幻覚の少ない大型マルチモーダル モデルであり、複数画像の理解、オブジェクトの位置決め、OCR などの機能もサポートしています。 Chatimg3.0 はハードウェア デバイスに頭脳を装備し、より自然でスムーズなヒューマン マシン コミュニケーションを可能にし、AI マルチモーダル大規模モデルを活用した産業用アプリケーションの強固な基盤を築きます。 Chatimg2.0と比較して、Chatimg3.0は主に、事前トレーニングの第1段階(記述、検出、OCRなどのマルチタスクトレーニング)と命令の微調整の第2段階を含む2つの側面でアップグレードされています。 (高品質手動精密スクリーニング) 説明書セット)。

マルチモーダル検索アルゴリズムはどのようにしてビデオ検索をより正確にしますか? テンセントの独占公開、超詳細

リンク: https://news.miracleplus.com/share_link/11255

ビデオ検索は、検索における最大の水平垂直カテゴリであり、ビデオ結果は検索語の約 50% の下に表示されます。 ただし、ビデオ リソースはテキスト Web リソースとは異なるため、ビデオの理解、ビデオの一致と並べ替え、インタラクティブな動作の点で新たな技術的課題が生じます。 近年、マルチモーダル技術は徐々に人々の視野に入ってきており、特にトランスフォーマー構造がNLPの分野で注目を集めて以降、視覚や音響などのマルチモーダル分野にも広がり、クロスモーダル融合のさらなる利便性と可能性をもたらしています。 。 マルチモーダル事前トレーニング(ViLBERT/VisualBERT/VL-BERT/ERNIE-ViLなど)、マルチモーダル融合技術(マトリックスベース、通常のNNベース、アテンションベースなど)、マルチモーダルアライメント技術、対比学習技術(CLIPの発展により、動画検索サービスの効率を飛躍的に向上させることも可能になりました。) Tencent QQ Browser の検索機能は、毎日数千万人が利用するツールとして重要な役割を果たしています。 ここ数年の動画制作・消費の傾向に伴い、人々は動画を消費したり検索したりすることにも慣れてきています。

Transformer よりも、BERT と GPT without tention、MLP の方が実際には強力です。

リンク: https://news.miracleplus.com/share_link/11256

https://mp.weixin.qq.com/s/rjW-0pMCKWp-SNjgFJEfmw

BERT、GPT、Flan-T5 などの言語モデルから、SAM や Stable Diffusion などの画像モデルに至るまで、Transformer は止められない勢いで世界を席巻していますが、人々は「Transformer が唯一の選択肢なのか?」と疑問を持たずにはいられません。 スタンフォード大学とニューヨーク州立大学バッファロー校の研究者チームは、この質問に対して否定的な答えを提供するだけでなく、新しい代替技術であるモナーク ミキサーも提案しています。 最近、チームは関連する論文といくつかのチェックポイント モデルおよびトレーニング コードを arXiv 上で公開しました。 ちなみにこの論文はNeurIPS 2023に選出され、口頭発表の資格を獲得しました。

マルチモーダル LLM 幻覚問題が 30% 減少しました! 業界初の「キツツキ」無重力トレーニング法が誕生 | 中国科学技術大学

リンク: https://news.miracleplus.com/share_link/11257

大規模なマルチモーダル モデルの「錯覚」問題を解決するために、命令の微調整をまだ使用していますか? 中国科学技術大学による研究では、まったく新しいアプローチを考案しました。それは、激しいトレーニングを必要とせず、プラグアンドプレイであるユニバーサル アーキテクチャです。モデルによって与えられるエラー テキストから直接始まります。」 「幻覚」が発生する可能性のある場所を特定し、それを写真と比較します。事実を判断し、最終的には直接修正を完了します。 彼らはこの方法を「キツツキ」と名付けました。 いわゆる「森の医者」が最初に木の虫食い穴を見つけて、その中の虫を食べるのと同じように、この記事で提案されている「キツツキ」もまた、マルチモーダルな大型モデルの「幻想」の医者であり、最初に問題を解決することができます。 . 一つ一つ診断して修正していきます。

北京大学チーム:大型模型の「幻覚」を誘発するには文字化けの連続だけ! 大きいアルパカも小さいアルパカもすべて募集中

リンク: https://news.miracleplus.com/share_link/11258

北京大学チームの最新の研究では、ランダムなトークンが大規模モデルで幻覚を誘発する可能性があることが判明しました。 Baichuan2-7B、InternLM-7B、ChatGLM、Ziya-LLaMA-7B、LLaMA-7B-chat、Vicuna-7B などの人気のある大規模モデルでも同様の状況が発生します。 これは、ランダムな文字列が大規模なモデルを制御して、任意のコンテンツを出力し、錯覚を「支持」できることを意味します。 上記の発見は、北京大学のユアン・リー教授の研究グループによる最新の研究によるものです。 この研究は、大規模モデルの幻覚現象が敵対的な例の別の視点である可能性が非常に高いことを提案しています。 この論文では、大規模モデルの幻覚を容易に誘発する 2 つの方法を実証するとともに、シンプルで効果的な防御方法も提案しており、コードはオープンソース化されています。

より高解像度で現実的な人体生成モデルである HyperHuman が登場し、暗黙的な構造拡散に基づいて、多くの SOTA をリフレッシュします。

リンク: https://news.miracleplus.com/share_link/11259

Vincent グラフに構造制御情報を導入するために、ControlNet ([1]) や T2I-Adapter ([2]) などの最近の代表的な作品では、所定のトレーニング済み Vincent グラフを調整するための非常に軽量でプラグアンドプレイの学習可能なブランチが追加されています。普及モデル。 ただし、元の拡散モデル ブランチと新しく追加された学習可能なブランチの間の機能ギャップにより、生成結果と制御信号の間に不一致が生じることがよくあります。 この問題を解決するために、HumanSD ([3] ) は、人間の骨格マップと特徴次元に入力された拡散モデルを直接結合するネイティブ制御ガイダンス手法を使用します。 この記事では、スナップ研究所、香港中文大学、香港大学、南洋理工大学のチームが、明示的な人間の外観と暗黙的な人間の外観を共同で学習する最新の高リアルな人体生成モデル HyperHuman を発表しました。ゼロショット MS-COCO データセットは、最高の画質 (FID、FID_CLIP、KID) と世代と人間のポーズの一貫性 (AP、AR) インデックスの結果を達成し、優れたテキストと画像の位置合わせインデックス ( CLIPスコア)の結果を反映し、幅広いユーザー主観評価において最適な結果を実現しました。

小型モデルはどのようにして大型モデルと競合できるのでしょうか? BIT は、Minde の大型モデルである MindLLM をリリースします。小型モデルには大きな可能性があります。

リンク: https://news.miracleplus.com/share_link/11260

北京工業大学の自然言語処理チームは、データ構築、モデル アーキテクチャ、評価、アプリケーションをカバーする大規模モデルの開発で蓄積された経験を包括的に導入する一連のバイリンガル軽量大規模言語モデル Ming De LLM – MindLLM をリリースしました。プロセスの詳細な各ステップ。 MindLLM は最初からトレーニングされており、1.3B と 3B の両方のバージョンがあり、一部の公開ベンチマークでは他のオープンソースの大規模モデルのパフォーマンスと一貫して同等またはそれを上回っています。 MindLLM は、小規模モデル向けに調整された革新的な命令調整フレームワークも導入し、その機能を効果的に強化します。 さらに、MindLLM は、法律や金融などの特定の垂直分野に適用される場合に優れたドメイン適応性も備えています。

Stable Diffusion のチームは、感情検出 AI をオープンソース化したいと考えています

リンク: https://news.miracleplus.com/share_link/11275

2019年、AmazonはAlexaアシスタントをアップグレードし、顧客が不満を抱いている可能性がある時期を検出し、それに応じてより共感を持って対応できる機能を追加した。 たとえば、顧客が Alexa に曲の再生を依頼し、Alexa が間違った曲をスケジュールし、その後顧客がイライラした口調で「いいえ、アレクサ」と言った場合、Alexa は謝罪して説明を求める可能性があります。 現在、テキストから画像へのモデル Stable Diffusion のトレーニングに使用されるデータセットの背後にあるチームは、同様の感情検出機能をすべての開発者が無料で利用できるようにしたいと考えています。

生成された分子は、逆分子設計の誘導拡散モデルでほぼ 100% 有効です

リンク: https://news.miracleplus.com/share_link/11262

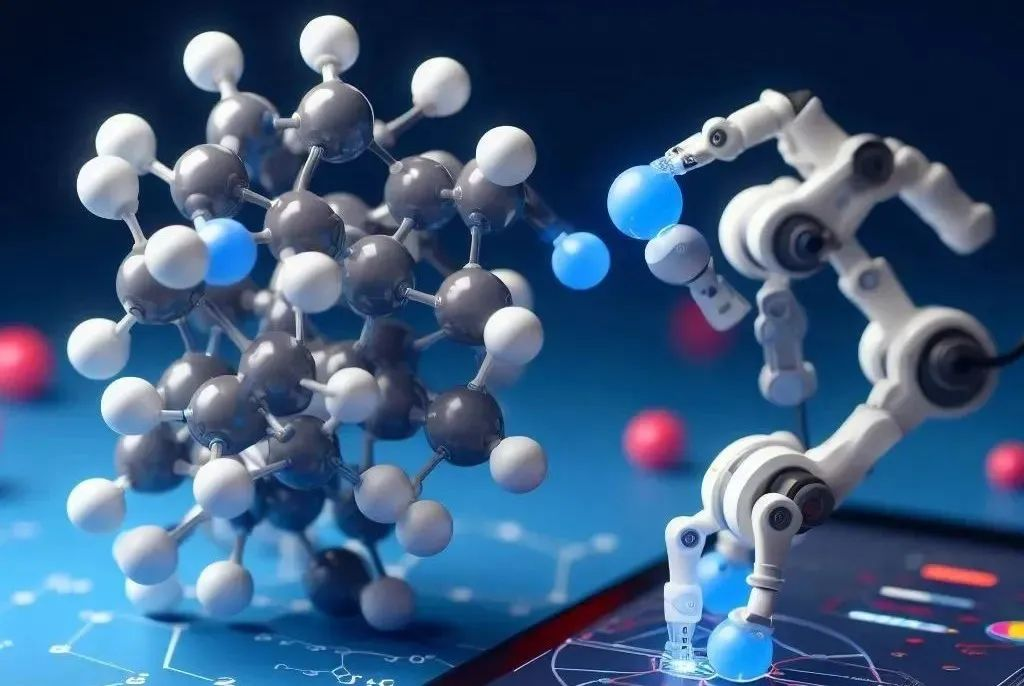

「新たな分子設計」は材料科学の「聖杯」です。 生成的深層学習の導入により、この方向は大きく前進しましたが、分子の発見は依然として困難であり、多くの場合非効率的です。 テクニオン・イスラエル工科大学とイタリアのヴェニスのカ・フォスカリ大学の研究チームは、等変グラフニューラルネットワークと生成拡散モデルを組み合わせた逆分子設計用の誘導拡散モデル、GaUDIを提案した。 研究者らは、生成された475,000の多環芳香族系のデータセットに単一および多目的タスクを適用することにより、有機エレクトロニクス用途向けの分子設計におけるGaUDIの有効性を実証した。 GaUDI は、改善された条件付き設計を実証し、元の分布を超えて最適な特性を持つ分子を生成し、データセット内の分子よりも優れた分子を提案します。 GaUDI は、ポイントごとのターゲットに加えて、最小値や最大値などのオープンエンドのターゲットに誘導することもでき、すべての場合において、生成された分子の有効性は 100% に近くなります。

30,000人の従業員にChatGPTサービスを提供! アジア最大手の銀行の 1 つが Microsoft と提携

リンク: https://news.miracleplus.com/share_link/11263

Asian Financial Briefing によると、アジア最大の銀行の 1 つであるオーバーシーチャイニーズ バンキング コーポレーション (OCBC) は、11 月からその完全子会社である BoS (アジア最大の民間銀行の 1 つ) を含む世界中の 30,000 人の従業員に OCBC ChatGPT サービスを提供する予定です。 )。 OCBC は今年 4 月の時点で Microsoft Azure OpenAI と技術協力を締結し、その膨大な財務データと微調整を組み合わせて銀行分野での ChatGPT アシスタントを作成しました。このアシスタントはテキストの生成、コンテンツの概要、電子メールの草案作成に使用できます。 、コンテンツの翻訳、投資レポートの作成など。 1,000人を超える従業員と、投資、管理、マーケティング、運用などの複数の中核部門による6か月間の共同テストを経て。 今後、OCBC ChatGPT は、OCBC に安全で信頼性の高い生成 AI サービスを提供するための日常ツールとして正式に機能します。